-

Compteur de contenus

706 -

Inscription

-

Dernière visite

-

Jours gagnés

14

Tout ce qui a été posté par bruno78

-

Bonjour, je reviens sur la question du renouvellement tous les 3 mois. dans les tâches planifiées, on choisit une date à T0+85 jours, et on donne une période de 3 mois au script. Donc si je comprends bien, on aura un premier renouvellement dans 85 jours, mais le suivant ne sera que 3 mois après, et non pas 85 jours. Donc pas de marge ? Par ailleurs, j'ai fait un test du script ce matin. Ci-dessous le retour du script : Tâche : Renew Certif LE WildCard Heure de début : Sun, 31 May 2020 07:12:36 GMT Heure d’arrêt : Sun, 31 May 2020 07:12:37 GMT État actuel : 0 (Normal) Sortie standard/erreur : [Sun May 31 07:12:36 CEST 2020] ===Starting cron=== [Sun May 31 07:12:37 CEST 2020] Already uptodate! [Sun May 31 07:12:37 CEST 2020] Upgrade success! [Sun May 31 07:12:37 CEST 2020] Auto upgraded to: 2.8.6 [Sun May 31 07:12:37 CEST 2020] Renew: 'xxxxxxx.eu' [Sun May 31 07:12:37 CEST 2020] Skip, Next renewal time is: Wed Jul 29 16:26:24 UTC 2020 [Sun May 31 07:12:37 CEST 2020] Add '--force' to force to renew. [Sun May 31 07:12:37 CEST 2020] Skipped xxxxx.eu [Sun May 31 07:12:37 CEST 2020] ===End cron=== Que faut'il en conclure ? Certificat créé hier, donc il "skip" la demande de renouvellement aujourd'hui estimant que c'est trop tôt, pas nécessaire ? date de prochain renouvellement 29 juillet 16:26 UTC 2020, soit 60 jours après la création ? si on période de 3 mois pour la tache periodique est trop longue, puiqu'a priori on ne peut pas faire une tâche avec une période de 2 mois, alors une tâche planifiée mensuelle ne serait'elle pas la solution ? Bruno78 @Jeff777, j'ai eu exactement ce problème (devoir mettre --force). En fait cela ne fonctionne pas même avec --force. Je suppose que tu as du passer en root avec un sudo ? C'était mon cas (sur PC avec Putty, je passais par un compte admin puis sudo -i), et il a fallu, sur les conseils bien avisés d' @oracle7, que je configure une "vraie" connexion root (voir tuto "Accès SSH et ROOT via DSM6"). Ca te règlera au moins ce problème là. Pour le reste, c'est au delà de mes compétences actuelles ..... Bruno78

- 937 réponses

-

- letsencrypt

- certificat

-

(et 1 en plus)

Étiqueté avec :

-

Déployement Nickel !! Merci

- 937 réponses

-

- letsencrypt

- certificat

-

(et 1 en plus)

Étiqueté avec :

-

Merco @oracle7 effectivement si on ne se trompe pas dans la génération des API Keys ni en les recopiant, et si on utilise la "vraie" connexion root (càd avec les clés ssh comme tu me l'as indiqué cf tuto "Accès SSH et ROOT via DSM6") et non pas du sudo alors ca fonctionne !! Il me reste maintenant à déployer le certificat ... Merci

- 937 réponses

-

- letsencrypt

- certificat

-

(et 1 en plus)

Étiqueté avec :

-

Oui, on a également le message "Tout les paquets" La connexion a échoué, vérifiez votre réseau et paramètre de l'heure" . cf Néanmoins, est-ce la cause de tes problèmes ? je ne sais pas ....

-

Merci @oracle7 pour ce super Tuto ..... je suis bloqué à l'étape de création du Certificat .... c'est ballot ! tout d'abord, via putty et après sudo -i pour passer en root, je me fais jeter sur certaine commandes ./acme.sh : root@ds918blam:/usr/local/share/acme.sh# ./acme.sh --upgrade --auto-upgrade It seems that you are using sudo, please read this link first: https://github.com/acmesh-official/acme.sh/wiki/sudo idem pour la création du certificat. Du coup obligé d'utiliser l'option --force ensuite, sur OVH, je n'ai réussi à créer les API Keys qu'avec mon identifiant OVH, mais pas avec mon login (email). et au final, en generant le certificat avec --force et les APi Keys générées avec mon identifiant OVH, j'ai l'erreur suivante (ndd masqué avec xxxx) ainsi que les clés: [Sat May 30 16:34:13 CEST 2020] Adding txt value: xxxxxxxxxxxxxxxxxx-0Y2a290 for domain: _acme-challenge.xxxx.eu [Sat May 30 16:34:13 CEST 2020] Using OVH endpoint: ovh-eu [Sat May 30 16:34:13 CEST 2020] OVH_API='https://eu.api.ovh.com/1.0' [Sat May 30 16:34:13 CEST 2020] Checking authentication [Sat May 30 16:34:13 CEST 2020] domain [Sat May 30 16:34:13 CEST 2020] GET [Sat May 30 16:34:13 CEST 2020] url='https://eu.api.ovh.com/1.0/auth/time' [Sat May 30 16:34:13 CEST 2020] timeout=30 [Sat May 30 16:34:13 CEST 2020] _CURL='curl -L --silent --dump-header /usr/local/share/acme.sh/http.header -g --connect-timeout 30' [Sat May 30 16:34:13 CEST 2020] Please refer to https://curl.haxx.se/libcurl/c/libcurl-errors.html for error code: 60 [Sat May 30 16:34:13 CEST 2020] ret='60' [Sat May 30 16:34:13 CEST 2020] _ovh_p='[hidden](please add '--output-insecure' to see this value)' [Sat May 30 16:34:13 CEST 2020] GET [Sat May 30 16:34:13 CEST 2020] url='https://eu.api.ovh.com/1.0/domain' [Sat May 30 16:34:13 CEST 2020] timeout= [Sat May 30 16:34:13 CEST 2020] _CURL='curl -L --silent --dump-header /usr/local/share/acme.sh/http.header -g ' [Sat May 30 16:34:13 CEST 2020] Please refer to https://curl.haxx.se/libcurl/c/libcurl-errors.html for error code: 60 [Sat May 30 16:34:13 CEST 2020] ret='60' [Sat May 30 16:34:13 CEST 2020] error [Sat May 30 16:34:13 CEST 2020] The consumer key is invalid: OlZrPWfCuyLxxxxxxxxxxxxxxxxx [Sat May 30 16:34:13 CEST 2020] Please retry to create a new one. [Sat May 30 16:34:13 CEST 2020] Error add txt for domain:_acme-challenge.xxxx.eu J'ai recréé 2 fois les API Keys, toujours la même erreur. Je cherche .....

- 937 réponses

-

- letsencrypt

- certificat

-

(et 1 en plus)

Étiqueté avec :

-

[Résolu] Problème avec le Centre de Paquets ?

bruno78 a répondu à un(e) sujet de Kramlech dans Installation, Démarrage et Configuration

Hello , effectivement, idem, "connexion a échoué. ......". -

Bonjour @aware j'utilise la visualisation "Single Stat", Show "Current" Ceci dit, je ne sais pas pourquoi a priori ce que tu utilises ne semble pas fonctionner .....

- 1449 réponses

-

- snmp

- monitoring

-

(et 1 en plus)

Étiqueté avec :

-

Bonjour, merci pour ton commentaire 🙂 A propos de l'uptime, ..... c'est extrèmement surprenant ! Le script est capable de remonter 2 valeurs depuis la freebox : "uptime_val" : il s'agit du uptime en secondes "uptime" : il s'agit du uptime, exprimé par la Freebox en valeur lisible (chaine de caractères). C'est la Freebox qui fait la conversion. Je viens de faire le test directement depuis un terminal sur fbx_telegraf: root@fbx_telegraf:/usr/local/py# python3 freebox_058.py -H | grep uptime freebox,endpoint=mafreebox.freebox.fr,tag1=System,tag2=NULL,tag3=NULL sys_uptime_val=1976296 freebox,endpoint=mafreebox.freebox.fr,tag1=System,tag2=NULL,tag3=NULL uptime="22 jours 20 heures 58 minutes 16 secondes" root@fbx_telegraf:/usr/local/py# sys_time = 1976296 secondes, ce qui équivaut à 22j, 20h, 58 min, 16sec uptime remonté lisible par la Freebox = "22 jours 20 heures 58 minutes 16 secondes". => c'est cohérent. A moins que ta Freebox ne soit pas à l'heure ????? mais je ne vois pas comment ! Peux-tu faite la vérification ci-dessus et reverifier avec l'uptime directement sur la Freebox ? Bruno78 PS : j'ai peut-être été trop vite ! C'est sur la Freebox ou sur le NAS que tu as 2 jours de décalage ?? . Ceci dit, pas plus de raison d'avoir 2 jours de décalage sur le NAS !

- 1449 réponses

-

- snmp

- monitoring

-

(et 1 en plus)

Étiqueté avec :

-

-

Bonjour, peux-tu stp donner la définition complète du reseau pihole_network ? (subnet / gateway / ip_range) ? en fait c'est l'ensemble de tes déclarations de reseaux et de services qui pourraient nous aider à trouver où est le bug .... Merci

-

@Jeoffrey Stinson-Cooper, sur la méthode à employer .... je ne pense pas que la difficulté soit très différente entre les méthodes. Via Portainer nécessite d'installer Portainer en préalable ..... Chaque méthode a ses adeptes 🙂. As tu configuré un accès ssh sur ton NAS ? le montage de volumes : permet d'avoir les données de certains répertoires du Docker synchronisées avec un répertoire de ton NAS. En particulier, si tu effaces ton Docker, si tu le mets à jour .... donc avec une nouvelle image, alors cette "synchronisation" va permettre à ta nouvelle image de repartir de là où elle avait été arrêtée. Cela permet de ne pas perdre les données (configuration, base de données, .....) DHCP Freebox : si tu souhaites utiliser le docker pihole du NAS en priorité, il faut positionner son adresse en première position dans la liste des DNS de la Freebox dans la section DHCP. Et ensuite, tu ajoutes les DNS secondaires, dans l'ordre de ton choix. Et si tu ne l'as pas encore suivi, je te conseille vivement de suivre le tuto suivant: de @Fenrir

-

[TUTO] Plex via docker, avec ou sans transcodage matériel

bruno78 a répondu à un(e) sujet de Einsteinium dans Tutoriels

Bonjour, si tu as suivi le tuto jusqu'à la partie 3, alors tu as fait la déclaration des volumes (partie 2) VOLUMES du tuto). Vidéo/Films /data/movies Vidéo/Séries /data/tvshows Musique /data/musics Ou équivalent... . Où se trouvent tes bibliothèques existantes pour le moment ? A la place de Vidéo/Films, Vidéo/Séries et Musique, il faut que tu indiques le chemin vers tes bibliothèques actuelles; et éventuellement que tu adaptes en fonction de l'organisation de tes bibliothèques. -

Bonjour, @Jeoffrey Stinson-Cooper puisque tu n'utilises pas le paquet Synology DNS Server, tu peux installer Pi-Hole en mode docker comme indiqué au début de ce tuto, sur le réseau Docker Host. il y a plusieurs façon de faire cette installation, soit via l'interface graphique DSM, soit en ligne de commande avec par exemple docker-compose.yaml, ou encore avec Portainer. attention également à faire les bons montages de volumes pour rendre l'installation persistante et facilement upgradable. POur les DNS publics à utiliser, perso j'utilise ceux de FDN, mais après le choix est vaste. Dans les réglages DHCP sur ta Freebox, il faudra indiquer ton >NAS comme serveur DNS (pointera donc sur le PiHole), plus d'autres DNS en backup.

-

Bonjour @Jeoffrey Stinson-Cooper, il faut que tu définisses ton besoin. Le Pi-Hole va jouer le rôle de serveur DNS sur ton réseau privé, avec la possibilité de filtrage (white lists, black lists ...) Est ce que tu utilises (utiliseras) le paquet Synology "DNS Server" ? (important pour définir comment installer le docker Pi-Hole) Quels DNS publics veux-tu utiliser ? Qui est le serveur DHCP sur ton réseau (la Freebox je suppose) ? Je n'ai pas encore pris Pi-Hole v5.0, mais déjà dis nous en plus sur ce que tu prévois de faire.

-

Bonjour, peux-tu nous montrer comment est installé MariaDB ? avec quels paramètres ? pourquoi MariaDB 5 et non pas MariaDB 10 ? ensuite, que donne la connexion à http://192.168.1.100/phpMyAdmin (càd sans le ./index.php) dans quel contexte utilises-tu MariaDB / phpMyAdmin ? avec une installation WordPress ? autre utilisation ? accèdes-tu à ta base de données en lignes de commandes via ssh ? avec MariaDb version 10, on aurait quelque chose comme ceci : root@ds918xxxx:~# /usr/local/mariadb10/bin/mysql -uroot -p Enter password: Welcome to the MariaDB monitor. Commands end with ; or \g. Your MariaDB connection id is 217 Server version: 10.3.11-MariaDB Source distribution Copyright (c) 2000, 2018, Oracle, MariaDB Corporation Ab and others. Type 'help;' or '\h' for help. Type '\c' to clear the current input statement. MariaDB [(none)]> SHOW DATABASES; +--------------------+ | Database | +--------------------+ | WP_xxxx | | WP_yyyy | | information_schema | | mysql | | performance_schema | | phpmyadmin | +--------------------+ 6 rows in set (0.001 sec)

-

Bonjour @Pierre-Adrien Bernabeu, @.Shad., effectivement, cela fonctionne aussi. Heureusement d'ailleurs. Soit on met l'OID "brut", soit on met l'alias. [[inputs.snmp.field]] name = "upsModel" oid = ".1.3.6.1.4.1.6574.4.1.1.0" Ou [[inputs.snmp.field]] name = "upsModel" oid = "SYNOLOGY-UPS-MIB::upsDeviceModel.0" Merci. Bruno78

- 1449 réponses

-

- snmp

- monitoring

-

(et 1 en plus)

Étiqueté avec :

-

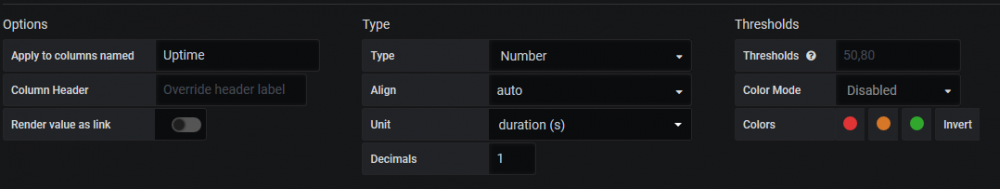

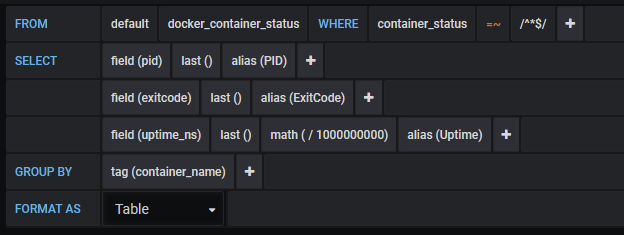

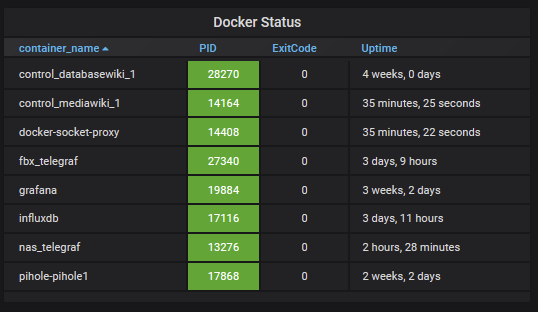

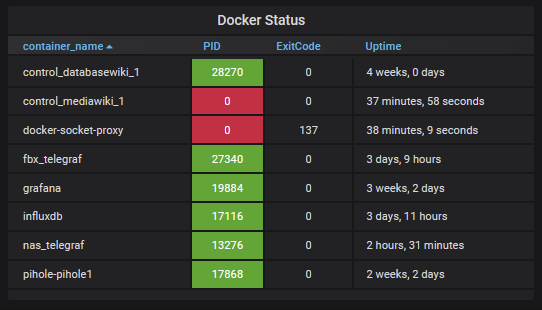

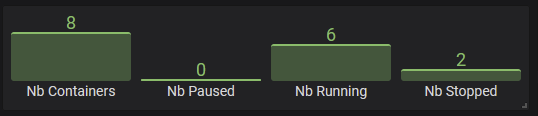

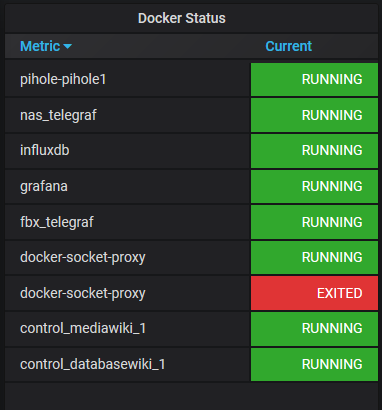

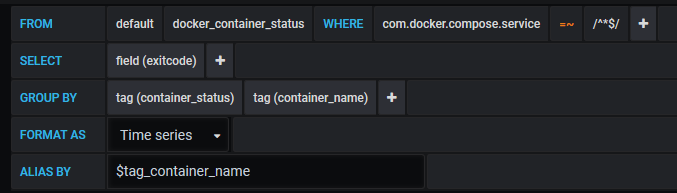

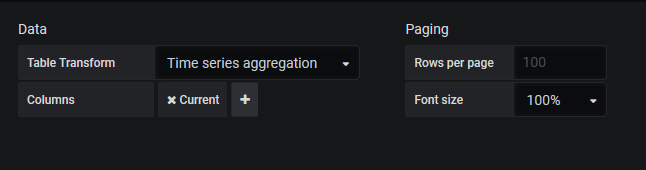

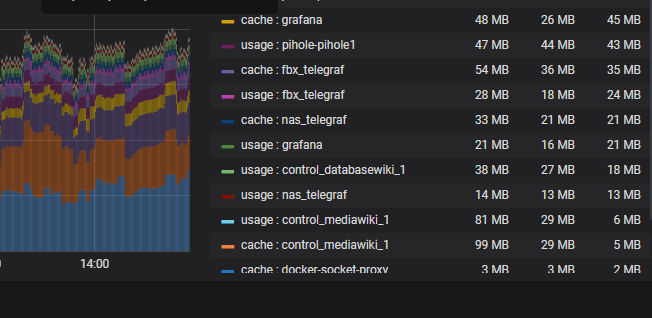

Bonjour, j'ai donc continué à chercher ... . Premier constat : l'exit code n'est pas fiable. Certains containers le positionnent, d'autre non; difficile de se baser dessus. Par ailleurs, il faut laisser remonter tous les états de containers via telegraf. Donc : modification du fichier de configuration de telegraf : telegraf.conf. la section "input plugin" / # # Read metrics about docker containers / [[inputs.docker]], décommenter la ligne contenant les états à charger : container_state_include = ["created", "restarting", "running", "removing", "paused", "exited", "dead"] sur grafana, on crée une requête chargeant le PID, le uptime et l'exitcode. On obtient quelque chose comme ceci (après mise en forme des colonnes) avec le PID entre autre. Ensuite je stoppe manuellement 2 containers (pour montrer la différence de comportement de l'exit code) On voit que l'exit code reste à 0 pour l'un, alors qu'il est positionné à 137 pour l'autre. Par contre les 2 remontent "0" comme PID On peut agrémenter d'un petit recap, par exemple : Je relance les 2 containers : et je retrouve bien mon affichage complet, sans doublon, avec les nouveaux PID pour les containers relancés. Bruno78

-

@.Shad. j'ai donc repris ton json et adapté pour mon cas, et il me reste un problème ... . Lorsque je teste le changement d'état d'un docker, il passe bien en status arrêt (exit code = 137 !). Par contre, lorsque je relance le docker, il me reste au niveau de grafana 2 états : l'ancien état (137) et le nouvel état (0). Et je n'arrive pas à voir comment me débarrasser ce cet ancien état ! (cf. ci dessous, 2 états pour docker-socket-proxy). Il me manque encore une étape !

-

@.Shad. merci pour le json. Je vais regarder Sinon effectivement, pas de méthode miracle. De la lecture sur le site de Grafana, de l'import de nombreux exemples pour adapter, .... et de nombreux essais. Mais au fur et à mesure, on finit quand même par savoir plus ou moins où aller.

-

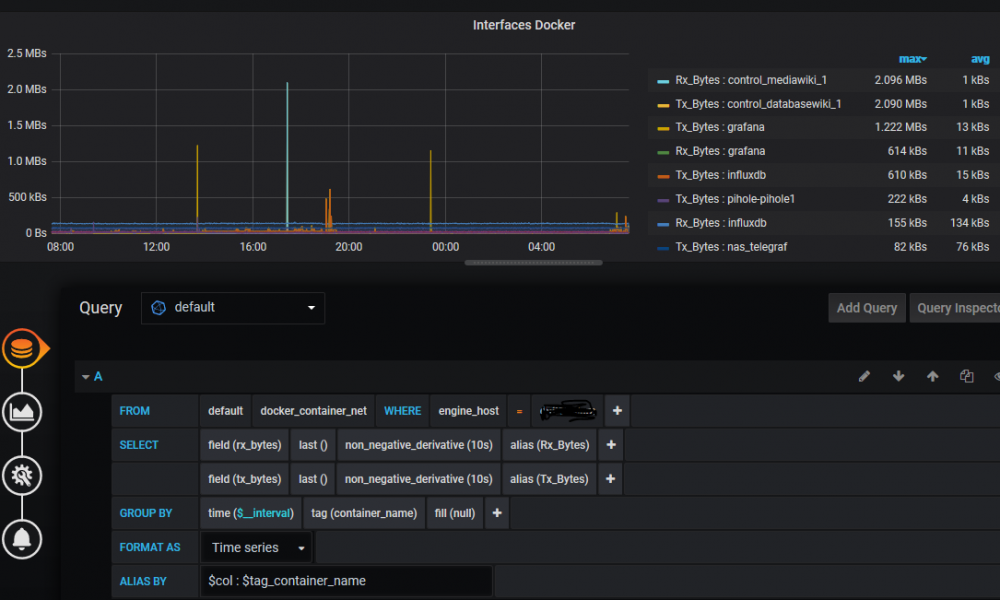

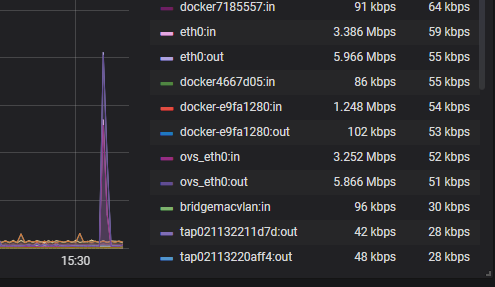

Bonjour, alors effectivement, si on utilise la table globale ifTable, les réferences docker sont "codées", du style "docker-e9f01980". Par contre, si on prend les données à partir de "docker_container_net", pas de problème. Par contre je tourne en rond sur un autre type de monitoring : je souhaite avoir un monitoring global des containers dockers : un pavé synthétique vert/en marche ou rouge/arret pour chaque container ..... Quelles variables utiliser ? comment visualiser sur grafana ? comment as-tu codé ton pavé "container overview" ? Bruno78

-

Oui en fait : pour les interfaces, effectivement il y a un peu de tout suivant le type d'interface: cela mériterait d'être décrypté : pour le docker, par exemple si on graphe le cpu ou la mémoire, on a bien le hostname configuré dans le docker compose : (à ceci prêt qu'il m'a aussi, pour certains, ajouté "control_" devant le hostname. "control" étant le nom du repertoire qui contient le docker-compose.yaml. Il faut que je regarde pourquoi , et pourquoi certains et pas d'autres) Bref, il faut que je regarde quelle est la logique.

-

Bonjour @Jeff777 la j'avoue mon ignorance totale sur le xDSL. Ce sont les champs décrit sur l'API Freebox, ici en particulier pour le xDSL https://dev.freebox.fr/sdk/os/connection/#XdslStats

-

c'est vrai, ca c'était avant ... depuis 2 jours avec la nouvelle Fbox après echange SAV, je suis plutôt entre 50 et 55°, au même emplacement.....

-

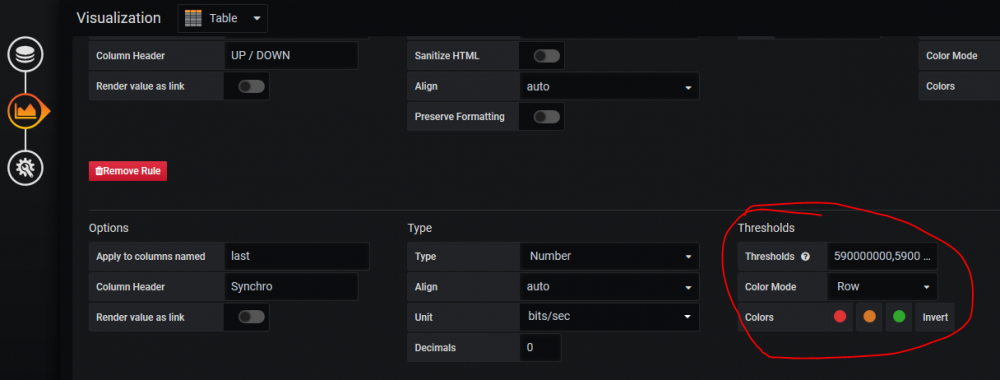

ah ben voilà !! Il n'y a plus qu'à jouer avec les paramètres et customiser le dashboard en fonction de tes souhaits. Bravo. Mais elle à pas un peu chaud, là ? ça me parait beaucoup. Sur les débit de synchro, le fait que ce soit en rouge, c'est simplement parce que j'ai mis dans la requete des seuils en fonction de ma connexion ftth. Pour ta liaison xdsl, il faut adapter. C'est la partie Threshold dans l'onglet visuallization qu'il faut adapter.

-

donc ça se présente mieux ..... il doit maintenant y avoir des données qui remontent si tu configures ce script dans telegraf . Pour mon info, tu avais donc bien des caractères accentués ?